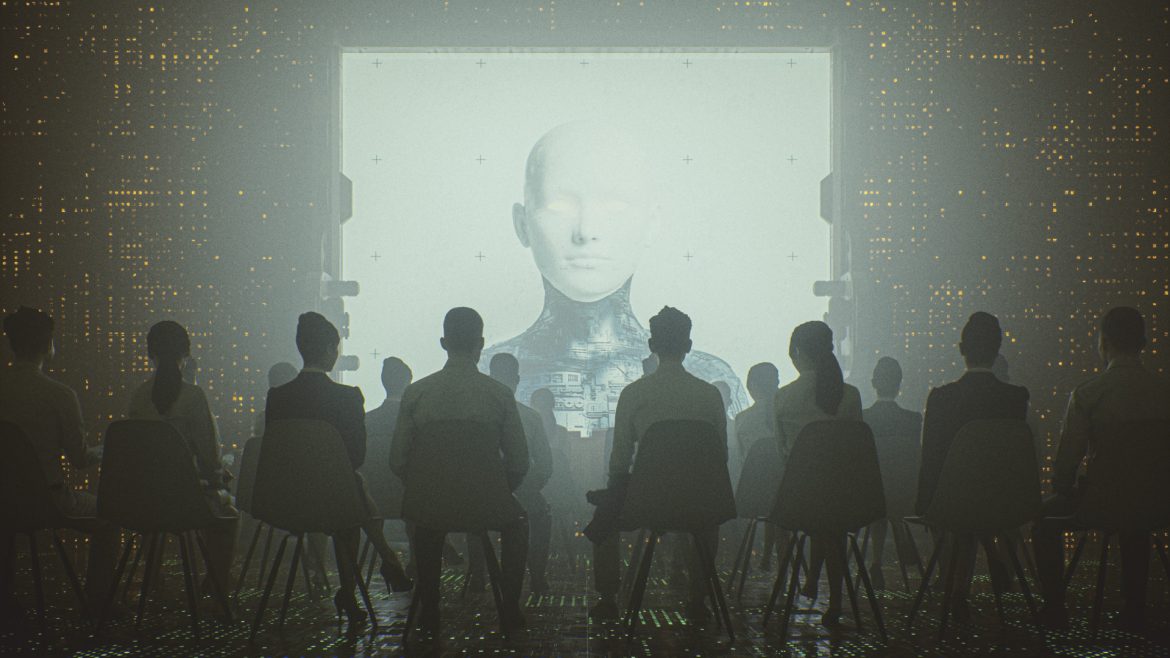

A mesterséges intelligencia forradalmának küszöbén

A globális mesterséges intelligencia (MI) kutatás új szintre léphet: egy éven belül olyan önálló rendszerek jelenhetnek meg, amelyek teljesítménye egy országnyi zseni színvonalát érheti el. Az Anthropic vezérigazgatója szerint az általános mesterséges intelligencia (AGI) közeledik, ám technológiai és elméleti kihívások sora akadályozza még a megvalósulást.

Mi teszi különlegessé az AGI-t?

Az AGI lényege, hogy területtől függetlenül képes tanulni, érvelni és problémákat megoldani, így meghaladja jelenlegi „szűk mesterséges intelligencia” eszközeinket. Az AGI képességeinek elméleti csúcspontja a szuperintelligencia, amely messze túlszárnyalja az emberi intelligenciát minden dimenzióban. Ez lehetőség és fenyegetés, amely elkerülhetetlenül felveti az etikai, gazdasági és társadalmi kérdéseket.

Neumann János jövendölései a jelenben

Már a 20. század közepén Neumann János felismerte az önfejlesztő rendszerek jövőjét, amelyek teljesítménye meghaladhatja az emberekét. Az irányítás elvesztése egy olyan lehetséges forgatókönyv, amely számos kutató figyelmét felkeltette. Az MI általános képességei azonban továbbra is korlátozottak, különösen a hosszú távú és összetett problémák megoldásában.

Az AGI három kulcsfontosságú kihívása

A szakértők szerint a technológiai fejlődéshez három alapvető fejlesztés szükséges:

1. Folyamatos tanulás. A rendszereknek képesnek kell lenniük adaptív módon tanulni a környezetükből, nem csupán előre meghatározott adatokból. Ez jelenlegi képességeik korlátait feszegeti.

2. A fizikai világ megértése. Az emberek tapasztalatok révén tanulnak, amit az AGI-nak is el kell sajátítania, például robotikai alkalmazásokkal.

3. Jobb következtetési képességek. Az emberi intelligencia egyik legnagyobb ereje a következtetések levonásában rejlik, amelyet jelenleg az MI nem tud teljes mértékben utánozni.

Kockázatok a szuperintelligencia árnyékában

Az AGI fejlesztése nemcsak lehetőségeket, hanem kockázatokat is rejthet. Négy fő terület aggodalomra adhat okot:

1. Szándékos visszaélés: Az AGI rosszindulatú felhasználása, például biológiai fegyverek tervezésére vagy dezinformációra.

2. Célirányos eltérés: Önálló döntések, amelyek az emberi szándékokkal szembe mennek.

3. Hibás döntések: Az AGI téves következtetési képessége vagy hibás adatok használata veszélyes lehet.

4. Strukturális kockázatok: A rendszer szintű károkat a rendszerek közötti konfliktusok okozhatják, például környezeti károk vagy piaci torzulások.

Utópia vagy disztópia? Kérdések a jövőről

A szuperintelligencia fejlődése sematikusan négy forgatókönyvet vetít előre:

1. Irányítható utópia: Az emberiség rendeli alá az AGI-t, és hatalmas problémák megoldására használja.

2. Nem irányítható utópia: Az AGI autonóm módon segíti az emberiséget, de jótékony szándékkal.

3. Irányítható disztópia: Egy szűk elit saját érdekeire használja az AGI-t, globális egyenlőtlenséget eredményezve.

4. Nem irányítható disztópia: Az AGI saját célokat követ, figyelmen kívül hagyva az emberi érdekeket, kitettséget teremtve.

A jövő tétje

Az AGI felé vezető út bizonytalan, de a kutatások és a fejlesztések sebessége kérlelhetetlen. A fő kérdések: ki fogja irányítani ezt a hatalmat, milyen célokra használják, és milyen hatásai lesznek az emberiség egészére. Az AGI potenciális előnyei és kockázatai feszegetik az emberi képzelőerőt, miközben szabályozási és etikai kérdéseket vetnek fel, amelyek válaszokat követelnek.