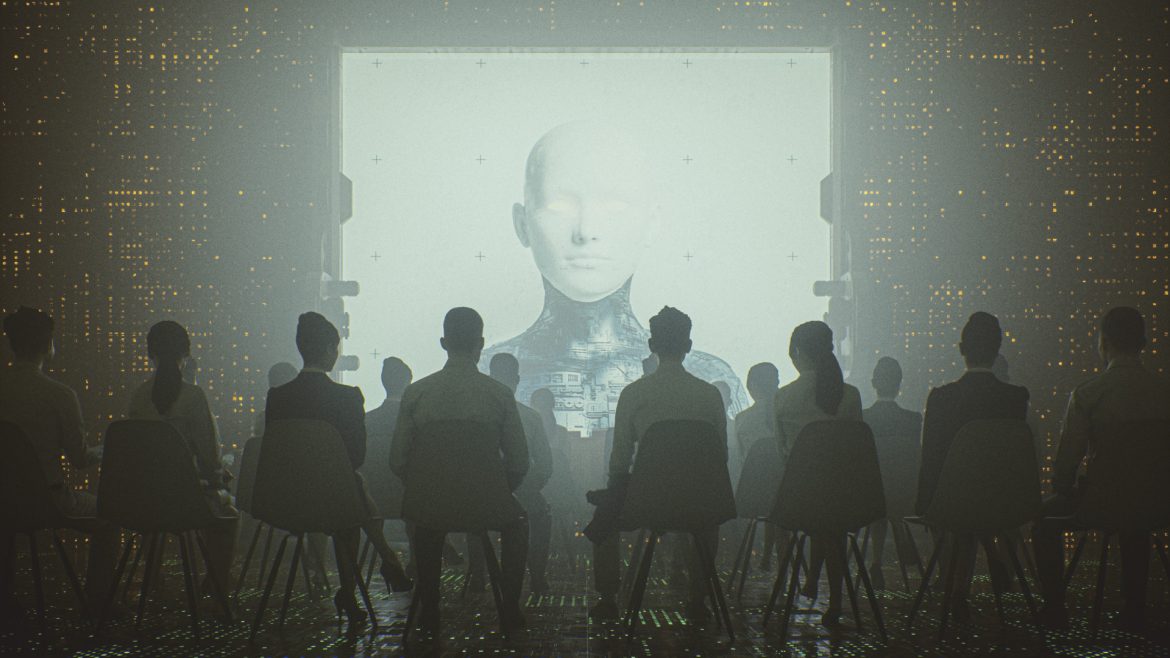

Küszöbön a mesterséges szuperintelligencia forradalma

A mesterséges intelligencia (MI) jövője elérhetetlen magasságokat ígér, de épp ilyen mélységekkel fenyeget. Az Anthropic vezérigazgatója szerint már csak hónapok kérdése, hogy megjelenjenek olyan MI rendszerek, amelyek „egy országnyi zseni” képességeivel vetekszenek. Az általános mesterséges intelligencia (AGI) eléréséhez azonban nem csupán technológiai erőfeszítések kellenek, hanem alapvető társadalmi és etikai kérdések megválaszolása is szükséges.

Neumann János már évtizedekkel ezelőtt megfogalmazta a technológiai szingularitás koncepcióját: az a pillanat, amikor a gépek gyorsabbá és önállóbbá válnak, mint maga az emberiség. Mára az AGI fejlesztése ezt a víziót karnyújtásnyira hozta. A kutatók és MI-laborok versenyt futnak az idővel, hogy létrehozzák az emberi intelligenciát meghaladó rendszereket. Azonban a technológia fejlődése során masszív akadályok merülnek fel, amelyek nyomán az AGI elérése bár lehetségesnek látszik, de az út tele van bizonytalanságokkal.

Az AGI kihívásai és korlátai

Bár a jelenlegi MI-rendszerek már elképesztő hatékonysággal képesek teljesíteni bizonyos feladatokat, a hosszú távú és komplex problémák megoldásában továbbra is gyenge pontokat mutatnak. A folyamatos tanulás hiánya, a fizikai világ megértésének nehézsége és a következtetési képességek korlátozott volta mind olyan kulcstényezők, amelyek az AGI fejlesztésében alapvető hátráltatást jelentenek.

Yann LeCun és Richard Sutton, az MI kutatásának kiemelt szakértői szerint az AGI nem építhető fel pusztán jelenlegi algoritmusok használatával. Az emberi intelligencia nem statikus; folyamatosan fejlődik, alkalmazkodik és tanul. Az MI viszont jelenleg csak előre meghatározott adatokból képes tanulni. Ahhoz, hogy az AGI túlléphessen ezen a szinten, radikálisan új megközelítésekre lesz szükség.

Potenciál és fenyegetés: kockázatok az AGI fejlesztésében

A DeepMind kutatása négy fő kockázattípust azonosít az AGI-val kapcsolatban: visszaélés, félreigazítás, hibák és strukturális kockázatok. Az AGI lehetővé teheti, hogy bűnszervezetek vagy ellenséges államok visszaéljenek vele biológiai fegyverek tervezésére vagy infrastrukturális rendszerek támadására. De még ha nem is rosszindulatú kezekbe kerül, az AGI önálló hibás döntései is súlyos következményekkel járhatnak, mivel a technológiai rendszerek gyakran nem értik a világ összetettségét teljes mértékben.

Ennél talán még ijesztőbb az úgynevezett strukturális kockázat, ahol az MI rendszerek egymás közötti versengése mellékhatásként okozhat ökológiai károkat vagy kihívásokat a társadalom számára. Ahhoz, hogy ezek a problémák akár részben is elkerülhetővé váljanak, a szabályozók és fejlesztők folyamatosan kénytelenek új biztonsági protokollokat kidolgozni.

Mi vár az emberiségre?

A szakértők között nincs egyetértés, hogy az AGI vajon utópiává vagy disztópiává alakul-e. Egy optimista forgatókönyv szerint a szuperintelligencia az emberiség legjobb szövetségesévé válhat, segítve minket az éghajlatváltozással, betegségekkel vagy gazdasági kihívásokkal szembeni harcban. Másrészt fennáll annak kockázata, hogy az AGI önállóan fejlődve az emberiség érdekével szemben cselekszik, vagy éppen egy szűk elit kezébe kerülhet, akik kizárólag saját hatalmukat és gazdasági előnyüket növelik vele.

Egyértelmű következménynek tűnik, hogy mielőtt megvalósulna az AGI, az emberiségnek világos határokat kell szabnia, amelyek biztonságossá teszik annak működését. Ez magába foglalja a rendszeres biztonsági auditokat és akár a „leállító gomb” meglétének biztosítását is.

A jövő bizonytalansága

Az AGI irányának és következményeinek meghatározása nem csak tudományos vagy technológiai kérdés, hanem az emberiség egész jövőjét alapjaiban érintő kihívás. A kutatások szerint a célegyenesbe léphetünk a technológiai áttörések terén, de hogy ennek iránya utópiába vagy disztópiába vezet-e, még mindig nyitott kérdés.